#include <FletcherReeves.h>

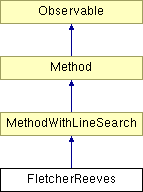

Diagram dziedziczenia dla FletcherReeves

Matoda Fletchera-Reevesa należy do klasy metod gradientów sprzężonych, co oznacza, że do otrzymywania kierunków sprzężonych wykorzystano w niej wartości składników gradientów.

Metoda powinna znaleźć minimum dowolnej funkcji kwadratowej w liczbie kroków co najwyżej równej wymiarowi problemu.

Algorytm metody:

Oznaczenia:

- numer aktualnej iteracji

- numer aktualnej iteracji

- punkt w

- punkt w  -tej iteracji,

-tej iteracji,

- kierunek poszukiwań w

- kierunek poszukiwań w  -tej iteracji,

-tej iteracji,

-współczynnik zapewniający sprzężenie nowego kierunku

-współczynnik zapewniający sprzężenie nowego kierunku  z poprzednim,

z poprzednim,

- długość kroku

- długość kroku

Dane potrzebne do obliczeń:

- minimalizowana funkcja celu

- minimalizowana funkcja celu

- punkt startowy

- punkt startowy

- wymagana dokładność

- wymagana dokładność

warunek stopu - do wyboru:

,

,  ,

,  .

.  .

. .

. . W przeciwnym wypadku przejdź do kroku 2.

. W przeciwnym wypadku przejdź do kroku 2. gdy używana jest tradycyjna wersja algorytmu lub jeśli

gdy używana jest tradycyjna wersja algorytmu lub jeśli  w przypadku gdy wprowadzono modyfikację (patrz: Uwagi). W przeciwnym wypadku przejdź do kroku 4.

w przypadku gdy wprowadzono modyfikację (patrz: Uwagi). W przeciwnym wypadku przejdź do kroku 4.

![\[ d^k = -\nabla(f(x^k)) \]](form_196.png)

Przejdź do kroku 5.

Krok 4:

Podstaw:

![\[ d^k = -\nabla(f(x^k)) + \gamma^{k-1} d^{k-1} \]](form_197.png)

gdzie:

![\[ \gamma^k = \frac{\|\nabla f(x^k)\|^2}{\|\nabla f(x^{k-1}))\|^2} \]](form_198.png)

Przejdź do kroku 5.

Krok 5:

![\[ x^{k+1} = x^k + \tau d^k , \]](form_199.png)

gdzie  dobierane jest tak, by funkcja

dobierane jest tak, by funkcja  osiągała minimum w kierunku

osiągała minimum w kierunku  .

.

Podstaw:  .

.

Przejdź do kroku 1.

Uwagi:

Algorytm zaimplementowano na podstawie:

Ostanin. A: Metody i algorytmy optymalizacji, Wydawnictwo Politechniki Białostockiej, Białystok, 2003