#include <SignOfDerivative.h>

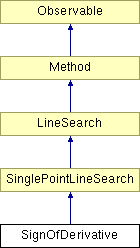

Diagram dziedziczenia dla SignOfDerivative

Metoda znaku pochodnej jest prostą metodą rozwiązywania problemów jednowymiarowych wykorzystującą znak pochodnej funkcji w punkcie.

Oznaczenia:

- punkt w danej iteracji

- punkt w danej iteracji

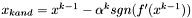

- kandydat na punkt w następnej iteracji

- kandydat na punkt w następnej iteracji

- współczynnik wpływu wartości pochodnej w punkcie na przesunięcie punktu roboczego

- współczynnik wpływu wartości pochodnej w punkcie na przesunięcie punktu roboczego

Dane potrzebne do obliczeń:

- minimalizowana funkcja jednej zmiennej

- minimalizowana funkcja jednej zmiennej

- punkt poczatkowy

- punkt poczatkowy

- wymagana dokładność rozwiązania

- wymagana dokładność rozwiązania

- początkowa wartość

- początkowa wartość  (może się zmniejszać gdy wykonywane kroki są za długie).

(może się zmniejszać gdy wykonywane kroki są za długie).

- współczynnik zmniejszania współczynnika

- współczynnik zmniejszania współczynnika  w przypadku, gdy wykonanie kroku dałoby gorszy wynik

w przypadku, gdy wykonanie kroku dałoby gorszy wynik

Krok 1:

Podstawić  ,

,  oraz

oraz  .

.

Krok 2:

Podstawić  , a następnie

, a następnie  .

.

Krok 3:

Obliczyć  .

.

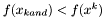

Jeśli  , podstawić

, podstawić  i przejść do kroku 5. W przeciwnym wypadku przejść do kroku 4.

i przejść do kroku 5. W przeciwnym wypadku przejść do kroku 4.

Krok 4:

Zmniejszyć  zgodnie ze wzorem:

zgodnie ze wzorem:  , a następnie przejsć do kroku 3.

, a następnie przejsć do kroku 3.

Krok 5:

Jeśli spełniony jest warunek zbieżności, zakoczyć działanie algorytmu i zwrócić  jako wynik. W przeciwnym wypadku przejść do kroku 2.

jako wynik. W przeciwnym wypadku przejść do kroku 2.

Algorytm zaimplementowano na podstawie pracy dyplomowej:

Grabowski J.: Numeryczne metody optymalizacji, miejsce i data obrony: Politechnika Wrocławska