#include <RosenbrockDiscrete.h>

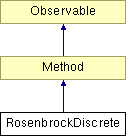

Diagram dziedziczenia dla RosenbrockDiscrete

Metoda poszukiwań prostych.

Podobnie jak algorytm Hooke'a i Jeevesa, oparta jest na wykonywaniu w każdej iteracji kroków próbnych wzdłuż  ortogonalnych kierunków. Kierunki te, inaczej niż w metodzie HJ, mogą się zmieniać - na końcu każdej iteracji baza kierunków

ortogonalnych kierunków. Kierunki te, inaczej niż w metodzie HJ, mogą się zmieniać - na końcu każdej iteracji baza kierunków  jest obracana w taki sposób, aby zawierała kierunek największej poprawy i pozostałych

jest obracana w taki sposób, aby zawierała kierunek największej poprawy i pozostałych  wzajemnie ortonormalnych kierunków.

wzajemnie ortonormalnych kierunków.

Informacje wejściowe:

- minimalizowana funkcja

- minimalizowana funkcja  zmiennych,

zmiennych,

- dowolnie wybrany punkt startowy,

- dowolnie wybrany punkt startowy,

- n-wymiarowy wektor początkowych długości kroku,

- n-wymiarowy wektor początkowych długości kroku,

- współczynnik wydłużania kroku (

- współczynnik wydłużania kroku ( ),

),

- współczynnik skracania kroku (

- współczynnik skracania kroku ( ),

),

- wstępny warunek stopu - minimalna długość kroku próbnego,

- wstępny warunek stopu - minimalna długość kroku próbnego,

- dokładność właściwego warunku stopu,

- dokładność właściwego warunku stopu,

warunek stopu - do wyboru:

,

,  ,

,  ,

,

Oznaczenia:

- indeks aktualnego kierunku,

- indeks aktualnego kierunku,

- numer aktualnej iteracji,

- numer aktualnej iteracji,

- aktualna baza kierunków,

- aktualna baza kierunków,

- wektor sum długości udanych kroków próbnych w poszczególnych kierunkach,

- wektor sum długości udanych kroków próbnych w poszczególnych kierunkach,

- aktualny punkt próbny,

- aktualny punkt próbny,

- najlepszy punkt w k-tym etapie,

- najlepszy punkt w k-tym etapie,

- wartość funkcji w punkcie

- wartość funkcji w punkcie  ,

,

- najlepsza wartość funkcji przed rozpoczęciem przeszukiwania kierunków z bazy,

- najlepsza wartość funkcji przed rozpoczęciem przeszukiwania kierunków z bazy,

- wektory sum przesunięć wykorzystywane przy obrocie bazy,

- wektory sum przesunięć wykorzystywane przy obrocie bazy,

- kwadraty norm wektorów

- kwadraty norm wektorów  wykorzystywane przy normalizacji nowej bazy (

wykorzystywane przy normalizacji nowej bazy ( ).

).

Procedura.

Krok wstępny:

Podstawiamy:

![\[ D = I(n), \mbox{ gdzie } I(n) - \mbox{ macierz jednostkowa } n \times n , \]](form_213.png)

![\[ \lambda = 0(n), \]](form_427.png)

![\[ x^1_{min} = x^0, \]](form_214.png)

![\[ F^0_{min} = f(x^0) , \]](form_428.png)

![\[ F^1_{min} = f(x^0) , \]](form_215.png)

![\[ F^1_b = f(x^0) , \]](form_429.png)

![\[ \tau = \tau_0 , \]](form_430.png)

![\[ k = 1 , \]](form_218.png)

![\[ i = 1 . \]](form_219.png)

Krok 1:

Badamy wartość funkcji w nowym punkcie próbnym (wykonując krok w i-tym kierunku):

![\[ x^i = x^k_{min} + \tau^{(i)} D^{(i)} . \]](form_431.png)

Jeśli krok był udany ( ), to dodajemy długość kroku do sumy

), to dodajemy długość kroku do sumy  , wydłużamy krok w bieżącym kierunku i zapamiętujemy aktualny punkt jako najlepszy:

, wydłużamy krok w bieżącym kierunku i zapamiętujemy aktualny punkt jako najlepszy:

![\[ \lambda^{(i)} = \lambda^{(i)} + \tau^{(i)}, \]](form_433.png)

![\[ \tau^{(i)} = \alpha \tau^{(i)}, \]](form_434.png)

![\[ x^k_{min} = x^i, \]](form_222.png)

![\[ F^k_{min} = f(x^i). \]](form_226.png)

Jeśli krok był nieudany ( ), to skracamy krok w bieżącym kierunku i odwracamy jego zwrot:

), to skracamy krok w bieżącym kierunku i odwracamy jego zwrot:

![\[ \tau^{(i)} = -\beta \tau^{(i)}. \]](form_435.png)

Podstawiamy  i sprawdzamy, czy

i sprawdzamy, czy  . Jeśli tak, ponownie wykonujemy krok 1. Jeśli nie, podstawiamy

. Jeśli tak, ponownie wykonujemy krok 1. Jeśli nie, podstawiamy  i przechodzimy do kroku 2.

i przechodzimy do kroku 2.

Krok 2:

Sprawdzamy, czy przy ostatnim przeszukiwaniu  kierunków nastąpiła poprawa.

kierunków nastąpiła poprawa.

Jeśli tak ( ), to podstawiamy:

), to podstawiamy:

![\[ F^k_b = F^k_{min} \]](form_437.png)

i przechodzimy do kroku 1. W przeciwnym wypadku przechodzimy do kroku 3.

Krok 3:

Sprawdzamy wstępny warunek stopu:

![\[ \min_{i \in \overline{1,\ldots,n}} |\tau^{(i)}| < \delta \]](form_438.png)

i zapamiętujemy jego wartość logiczną.

Następnie sprawdzamy, czy w całej iteracji nastąpiła poprawa - jeśli tak ( ), to przechodzimy do kroku 4.

), to przechodzimy do kroku 4.

W przeciwnym wypadku ( ), jeśli wstępny warunek stopu jest spełniony, to STOP. Jeśli nie jest, podstawiamy

), jeśli wstępny warunek stopu jest spełniony, to STOP. Jeśli nie jest, podstawiamy  i przechodzimy do kroku 1.

i przechodzimy do kroku 1.

Krok 4:

Sprawdzamy główny warunek stopu. Jeśli ten oraz wstępny warunek stopu z kroku 2 są spełnione, to STOP. W przeciwnym razie przechodzimy do kroku 5.

Krok 5:

Dokonujemy obrotu bazy, według algorytmu Palmera:

1) Dla  :

:

Wyliczamy wektory sum przesunięć:

![\[ A_i = \sum_{j=i}^n \lambda^{(j)} D^{(j)} \]](form_442.png)

oraz wektor  :

:

![\[ t_i = \|A_i\|^2 . \]](form_444.png)

2) Tworzymy nowe kierunki ortonormalne  :

:

a) Dla  :

:

![\[ div = \sqrt{t_{i-1} t_i} . \]](form_447.png)

![\[ \mbox{Jesli } div \ne 0 : D^{(i)} = \frac{\lambda^{(i-1)} A_i - D^{(i-1)} t_i}{div} , \]](form_448.png)

b) Na koniec tworzymy kierunek największej poprawy  .

.

![\[ div = \sqrt{t_1} , \]](form_449.png)

![\[ D^{(1)} = \frac{A_1}{div}. \]](form_450.png)

W ten sposób otrzymujemy nową bazę kierunków  .

.

Następnie podstawiamy:

![\[ \tau = \tau_0 , \]](form_430.png)

![\[ \lambda = 0(n), \]](form_427.png)

![\[ x^{k+1}_{min} = x^k_{min}, \]](form_451.png)

![\[ F^{k+1}_{min} = F^k_{min}, \]](form_452.png)

![\[ F^{k+1}_b = F^k_{min}, \]](form_453.png)

![\[ k = k + 1 \]](form_454.png)

i przechodzimy do kroku 1.

Uwagi.

Oryginalna metoda Rosenbrocka wykorzystywała przy ortonormalizacji nowej bazy metodę Grama-Schmidta. W tej implementacji użyto metody Palmera, bardziej wydajnej i tworzącej poprawną bazę również w przypadku, gdy w iteracji istnieją kierunki, w których nie wykonano żadnego udanego kroku.

Metoda zaimplementowana na podstawie programu Franka Vanden Berghena (http://iridia.ulb.ac.be/%7Efvandenb/download.php?id=33), który powstał na podstawie publikacji:

1) Rosenbrock, H. H., An Automatic Method for Finding the Greatest or Least Value of a Function (1960). (http://iridia.ulb.ac.be/~fvandenb/optimization/paper_rosenbrock.zip)

2) Palmer, J. R., An improved procedure for orthogonalising the search vectors in Rosenbrock's and Swann's direct search optimisation methods (1969). (http://iridia.ulb.ac.be/~fvandenb/optimization/paper_palmer.zip)